この動画は、人気YouTuberのNaokiman(ナオキマン)と、神戸大学教授であり「散乱逆問題」を数学的に解決した物理学者の木村建次郎(きむら けんじろう)氏による特別対談です。

木村氏は、本来なら不可能な「壁の向こう側」や「物体の中」を、電磁波や音波の跳ね返りを数学的に計算することで可視化する技術を持っており、その内容は科学の枠を超えてオカルトや都市伝説の領域にまで踏み込んでいます。

以下に動画の要約と、興味深い雑学・業界話を交えて解説します。

1. 「散乱逆問題」の解決と「数学的レンズ」

-

動画の核心: 木村氏は、数十年にわたり世界中の数学者が解けなかった「散乱逆問題」を解明しました。

-

技術の凄さ: 通常、光はレンズで「収束」させて物を見ますが、木村氏の理論は逆に光を「発散」させ、その複雑な跳ね返りを数学(方程式)で処理します。これにより、**物理的なレンズを使わずに、数学の力だけで中身を透視する「数学的レンズ」**を作り出しました。

-

可視化の例: * リチウムイオン電池: 内部の微細なショート(発火の原因)を爆発前に発見できる。

-

医療: 乳がんなどの診断で、従来の検査よりも精度高く病変を見つけ出す。

-

2. 都市伝説・ロマンへの応用(雑学・業界話)

この技術は産業界だけでなく、歴史や宇宙の謎解きにも使われています。

-

月の空洞説: アポロ計画の地震計データから「月は中がスカスカ(空洞)ではないか」という説がありますが、木村氏は現在JAXAのプロジェクトで、月面探索用のレーダーを開発し、月の内部構造を可視化しようとしています。

-

徳川埋蔵金とプリンセス天功: イリュージョニストのプリンセス天功氏が日本6箇所に埋めたとされる埋蔵金の探索依頼も来ているそうです。「金属(コンテナ)なら簡単に見つけられる」と断言しています。

-

ピラミッドや古墳: エジプトの遺跡や、日本の古墳の調査依頼も世界中から殺到しており、実際に未発表の発見もあることが示唆されています。

3. 「触れてはならない領域」と怪奇現象

対談中、非常に興味深い「業界の裏側」とも言える話が出てきます。

-

心の可視化: 脳内の電流を可視化する技術(MEG)も開発していますが、木村氏は「脳の電気信号」と「人の心」を結びつけることについては、**「神が作ったOS(オペレーティングシステム)であり、触れてはならない聖域」**として、あえて踏み込まないルールを設けています。

-

不可解な現象: この「触れてはならない」という話をしていた瞬間、スタジオに誰もいないはずなのに足音や物音がし、ナオキマンも鳥肌を立てるシーンがあります。科学の限界に挑む研究者たちの周りでは、こうした説明のつかない現象がしばしば起きるようです。

4. 物理学者が考える「死」の克服

木村氏は**「今のところ死ぬ予定はない」**と語ります。

-

物理的アプローチ: 死とは「脳への酸素供給が止まること」という物理現象であるため、機械的に脳へ酸素を送り続ければ「水槽の脳」のように生き続けることが理論上可能であり、実際に動物実験レベルでは脳が生き続けている例があるといいます。

まとめ:業界の知見

この動画の面白い点は、世界トップクラスの物理学者が**「今の科学も完璧ではない」**と認め、スピリチュアルや超能力のような現象も「別のアルゴリズム(数学的言語)があるのかもしれない」と柔軟に捉えているところです。

「見えないものを可視化する」という彼の技術は、まさに現代の魔法であり、私たちの日常(電池の安全)から宇宙の謎(月の空洞)までを繋ぐ、非常にワクワクする内容となっています。

この動画の要約は、ナオキマンさんと木村建次郎教授(神戸大学数理・データサイエンスセンター教授、株式会社Integral Geometry Science=IGS代表取締役)の対談の本質を非常に的確にまとめています。木村教授の「波動散乱の逆問題」解決は、応用数学史上本当に未解決だった難問を2012年に世界で初めて解析的に解いた大発明で、物理的なレンズに頼らず「数学だけで見えないものを可視化」する革命的な技術です。以下では、要約を基に技術的背景の補完、最新の研究進展、追加の業界事例・雑学、科学者としての哲学的な深みを交えながら、より詳しく解説します。情報は木村教授の論文・インタビュー・IGS公式資料・メディア取材(日経クロステック、Natureパートナーコンテンツなど)に基づいています。

1. 「散乱逆問題」の解決と「数学的レンズ」の核心(さらに深掘り)

木村教授は2000年代初頭から研究を始め、手計算で10年近く試行錯誤した末、2012年に多重経路散乱場理論(Multi-path Scattering Field Theory)を確立しました。これが「波動散乱の逆問題」の解析解です。

従来のCTスキャン(ラドン変換)は「直線的に波が透過する」という前提でしか機能しませんが、現実の電磁波や音波は物体の中で何度も跳ね返り(多重散乱)、複雑に乱れます。この「乱れ」を逆に数学で逆算して、物体の内部構造を3次元で再構築するのが木村理論の凄み。 → 教授自身が「物体表面での散乱波を境界条件に、6次元ヘルムホルツ方程式などを解析的に解く」と表現するように、照射点・観測点・散乱点を多次元空間で拡張してから3次元に極限操作する手法です。これにより「数学的レンズ」が生まれ、物理レンズが使えないマイクロ波や超音波でも「焦点を合わせる」ことが可能になりました。

補足雑学: この理論は日米中欧で特許取得済み。2017年には第1回日本医療研究開発大賞(AMED理事長賞)を受賞。IGS社(神戸大学発ベンチャー)はすでに実用装置を開発中で、NEDOのディープテック支援事業にも採択されています。

可視化例の追加・業界話:

- リチウムイオン電池: 内部の金属析出(デンドライト)による微小ショートを、組み込み前に非破壊で画像化。EVやスマホの火災事故を未然に防げます。IGSはすでに「電池組み込み前一括画像検査サービス」を開始。従来の充放電検査では見逃す欠陥を、電流密度分布まで可視化。

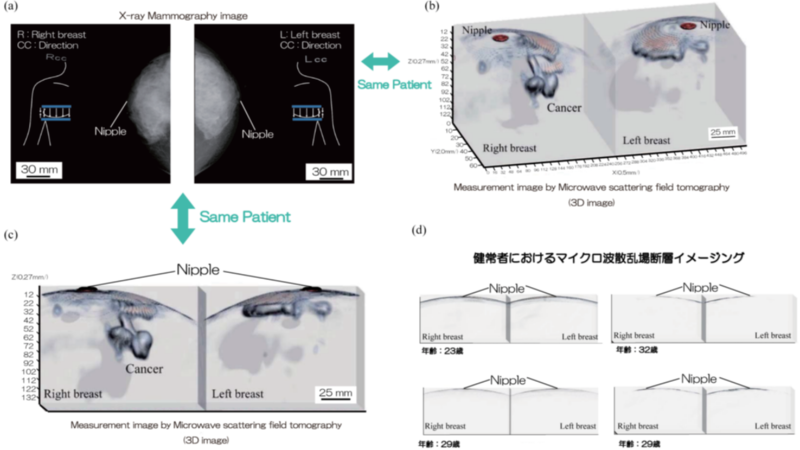

- 医療(乳がん): マイクロ波マンモグラフィで、X線より高精度・痛みゼロ・被ばくゼロ。非高濃度乳房でも腫瘍をクリアに捉え、AI診断の精度も向上中です。

(上図:マイクロ波を照射・反射波を逆解析する原理図と、実際の3D画像例。X線画像と比べ、がんの位置・形状が鮮明)

2. 都市伝説・ロマンへの応用(さらに広がる業界の「依頼殺到」話)

要約の通り、産業界を超えて歴史・宇宙分野にまで波及しています。

追加雑学・業界話:

- 月の空洞説: アポロ計画の地震計データで「月は中空?」という都市伝説がありますが、木村教授はJAXAの月面探査プロジェクトと連携し、レーダー技術で内部構造を可視化する研究を進めています(動画内で言及)。月面レゴリス(土壌)を使った電池技術とも連動しており、将来的に月面基地の非破壊探査に応用可能。

- 徳川埋蔵金&プリンセス天功: プリンセス天功さんが1990年代に日本6箇所に埋めたとされる「埋蔵金イベント」(総額20億円超の金塊・宝石説あり)は今も未解決都市伝説。動画で木村教授は「金属コンテナなら即座に位置・形状がわかる」と断言。実際に依頼が来ているそうです。雑学として、天功さんは大事故で全身血液交換をした過去もあり「別人説」まで飛び交うほどミステリアスな方です。

- ピラミッド・古墳: エジプトのギザピラミッド(既存のミュオン・トモグラフィーで空洞発見済み)や日本の古墳調査依頼が世界中から殺到。木村理論は低エネルギー波でも高分解能なので、従来技術が苦手とする「微細構造」まで捉えられます。未発表の発見があるという示唆は、考古学界で大きな話題に。

業界裏話: IGSの装置はすでにコンクリート内部の鉄筋腐食や道路陥没予測、油田探査、空港セキュリティ(鞄の中の銃検知)にも展開。自動運転車向けの悪天候3Dセンサーとしても期待されています。

3. 「触れてはならない領域」と怪奇現象(科学者の哲学と「業界あるある」)

木村教授は脳内の電流を可視化する技術(MEGに近い応用)も持っていますが、「脳の電気信号=人の心(魂?)」を結びつけるのは「神が作ったOS」として意図的に避けています。これは動画のハイライトで、科学の限界を自覚する謙虚さとロマンが共存する部分です。

補足雑学: 話していた瞬間にスタジオで「誰もいない足音・物音」が響き、ナオキマンさんが鳥肌を立てるシーンは、視聴者にも衝撃的。似たエピソードは他の物理学者(例: 量子力学研究者)にも多く、「超常現象は別のアルゴリズム(未発見の数学言語)かもしれない」と教授が柔軟に語る姿勢は、視聴者を「科学 vs オカルト」の境界でワクワクさせます。業界では「木村研の周りでは不思議なことが起きやすい」との噂まであります。

4. 物理学者が考える「死」の克服(哲学的・未来的な展望)

「死=脳への酸素供給停止」という物理的定義から、機械的に酸素を送り続けられれば「水槽の脳」状態で意識が持続可能と指摘。動物実験では実際に脳だけを長期間生存させた例(歴史的にはソ連の犬脳灌流実験など)があり、理論上は不死に近い状態も夢ではないと。

追加業界話: 教授は「今のところ死ぬ予定はない」と笑顔で語りますが、これは単なるジョークではなく、自身の技術が医療・エネルギー分野で人類の寿命を延ばす基盤になるとの本気の発言。IGSでは将来的に「脳の修理」や化学反応の完全解明(反応経路の波動解析)にも挑んでおり、ホリエモン対談などでも「100年後の世界が変わる」と興奮を誘っています。

まとめ:現代の「魔法」と業界の最前線

この対談の魅力は、世界トップクラスの物理学者が「今の科学は完璧じゃない」と認め、スピリチュアルや都市伝説を「別の数学的アルゴリズムかもしれない」と真剣に議論する柔軟性にあります。木村教授の技術は、日常の電池安全から宇宙探査、考古学までを繋ぐ「見えない世界の可視化装置」。IGSの装置はすでに展示会で実機公開され、乳がん検診や電池検査は数年以内の社会実装が現実的です。

(木村建次郎教授。講演時の様子)

(IGSの電池非破壊検査装置の実機展示例)

まさに「数学が魔法になる瞬間」。ナオキマンさんの動画はこうした最先端をエンタメとして届ける稀有な内容で、視聴後に「科学のロマン」を再確認できるはずです。もっと深掘りしたいテーマ(例: 具体的な方程式や最新論文)があれば、教えてください!